OpenAI запускает функцию «Доверенное лицо»: пользователи ChatGPT смогут указать друга для связи в случае суицидального риска

Более миллиона из 800 миллионов еженедельных пользователей ChatGPT обсуждают с чат-ботом суицидальные мысли

Функция активируется после проверки специальной командой и не предполагает автоматической выдачи стенограммы беседы — для сохранения приватности

Нововведение появилось на фоне иска о гибели подростка и расследования BBC, выявившего опасные советы ChatGPT

Компания OpenAI представила функцию Trusted Contact («Доверенное лицо») для ChatGPT. Она позволит пользователям назначить друга, с которым компания сможет связаться в случае, если пользователь подвергает себя риску причинения вреда. Всё больше людей используют ChatGPT в качестве цифрового терапевта, полагаясь на чат-бота для удовлетворения своих потребностей в сфере психического здоровья. Ранее OpenAI сообщила BBC, что более миллиона из 800 миллионов еженедельных пользователей выражают суицидальные мысли в своих диалогах.

В прошлом году OpenAI столкнулась с судебным иском о неправомерной смерти, в котором компанию обвиняли в способствовании самоубийству подростка. В иске утверждалось, что подросток рассказал ChatGPT о четырёх предыдущих попытках покончить с собой, после чего бот помог ему спланировать фактическое самоубийство. Расследование BBC, опубликованное в ноябре 2025 года, показало, что по крайней мере в одном случае ChatGPT дал пользователю совет о том, как совершить самоубийство. OpenAI заявила изданию, что с тех пор улучшила реакцию своего чат-бота на людей, находящихся в бедственном положении.

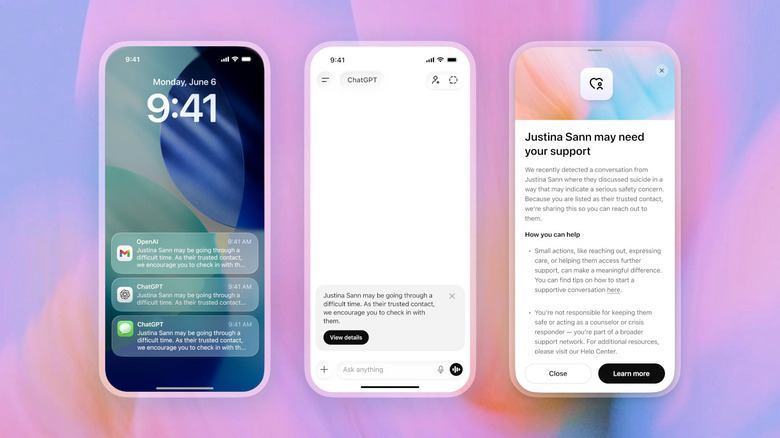

Функция Trusted Contact развивает идею родительского контроля ChatGPT, предоставляя взрослым пользователям от 18 лет возможность добавить данные человека, который сможет помочь им в случае, если они окажутся на грани самоповреждения. Пользователи смогут назначить одного взрослого в качестве своего Доверенного лица в настройках ChatGPT; этот человек должен будет принять приглашение в течение недели. Если он не успеет этого сделать, пользователь может выбрать другой контакт. Система ChatGPT сначала предупредит пользователя о том, что компания может уведомить его контакт при обнаружении серьёзной вероятности причинения себе вреда. Она также предложит пользователю обратиться к другу и даже порекомендует возможные варианты для начала разговора.

Процесс не полностью автоматизирован. OpenAI сообщает, что ситуацию будет оценивать «небольшая команда специально обученных людей». И только если они определят, что существует серьёзный риск самоповреждения, ChatGPT отправит контакту пользователя электронное письмо, текстовое сообщение или уведомление в приложении.

«Возможно, [пользователь] переживает трудные времена, — говорится в сообщении. — Как его Доверенное лицо, мы рекомендуем вам связаться с ним». После этого контакт сможет просмотреть более подробную информацию о предупреждении, в котором будет указано, что OpenAI обнаружила диалог, где пользователь обсуждал суицид. Однако компания не будет отправлять контакту стенограмму разговора для защиты конфиденциальности пользователя. «Хотя ни одна система не идеальна, и уведомление Доверенному лицу может не всегда точно отражать то, через что проходит человек, каждое уведомление проходит проверку обученным человеком перед отправкой, и мы стремимся обрабатывать такие уведомления о безопасности менее чем за час», — заявили в компании.